利用可再生能源进行电力系统恢复的DRL实践

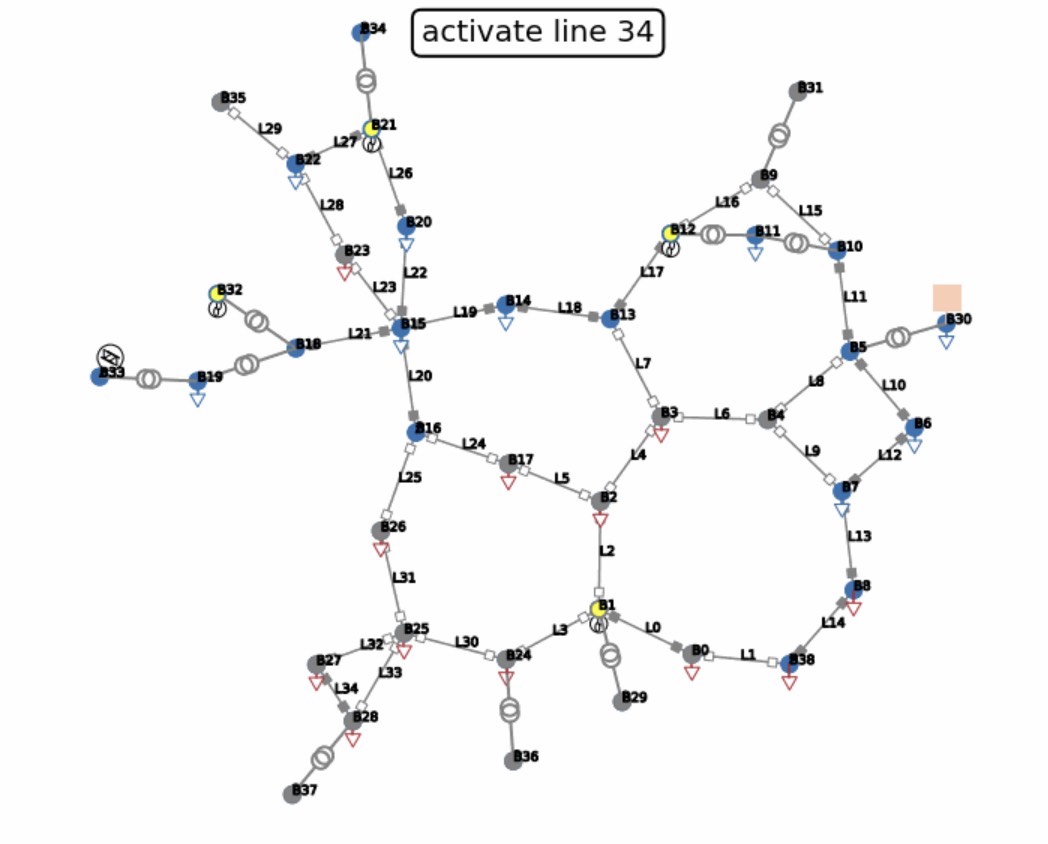

利用可再生能源进行电力系统恢复-DRL做法目标是开发 DRL 技术,该技术可以计算可再生能源比例较高的电力系统的恢复序列环境的初始状态模拟了大规模停电后电力系统的耗尽状态代理的任务是恢复所有负载的服务如果天气条件适宜,可再生能源发电机可用作黑启动资源,前提是启动电力由储能装置或电网提供可再生能源发电机的电力输出由获得的实际天气数据中随机选择的时间点决定,这些数据适用于附近的风能/太阳能发电厂mat

利用可再生能源进行电力系统恢复-DRL做法 目标是开发 DRL 技术,该技术可以计算可再生能源比例较高的电力系统的恢复序列 环境的初始状态模拟了大规模停电后电力系统的耗尽状态 代理的任务是恢复所有负载的服务 如果天气条件适宜,可再生能源发电机可用作黑启动资源,前提是启动电力由储能装置或电网提供 可再生能源发电机的电力输出由获得的实际天气数据中随机选择的时间点决定,这些数据适用于附近的风能/太阳能发电厂 gym for the RL agent setup pandapower for power system simulation stable_baselines for DRL algorithms matplotlib pandas numpy networkx PIL seaborn

在当今追求可持续能源的时代,利用可再生能源进行电力系统恢复成为了一个极具挑战性与潜力的领域。本文将探讨如何通过深度强化学习(DRL)来实现这一目标。

目标与背景

我们的目标是开发一套DRL技术,用于计算在可再生能源比例较高的电力系统中的恢复序列。想象一下,大规模停电后,电力系统处于耗尽状态,这就是我们环境的初始状态。而代理(agent)的任务艰巨——恢复所有负载的服务。

在这个过程中,如果天气条件适宜,可再生能源发电机就能作为黑启动资源,但启动电力得由储能装置或电网来提供。可再生能源发电机的电力输出是从实际天气数据中随机选择的时间点来决定的,这些数据来自附近的风能或太阳能发电厂。

工具与库的选择

- Gym:用于RL代理的设置,它为我们提供了一个标准化的环境接口,使得开发和测试RL算法变得更加容易。比如,我们可以这样初始化一个简单的Gym环境:

import gym

env = gym.make('CartPole-v1')这里创建了一个经典的CartPole环境,虽然与电力系统恢复环境不同,但展示了Gym简洁的使用方式。在电力系统恢复中,我们可以自定义一个继承自gym.Env的环境类,在类中定义状态、动作空间以及状态转移等逻辑。

- Pandapower:专门用于电力系统模拟。它提供了丰富的电力系统模型和计算方法。例如,创建一个简单的电网模型:

import pandapower.networks as nw

net = nw.case33bw()这就创建了一个33节点的配电系统模型,我们可以基于这个模型进行潮流计算、拓扑分析等,为电力系统恢复模拟提供基础。

- Stable - baselines:集成了众多DRL算法。以A2C算法为例,使用方式如下:

from stable_baselines.common.policies import MlpPolicy

from stable_baselines.common.vec_env import DummyVecEnv

from stable_baselines import A2C

env = DummyVecEnv([lambda: gym.make('CartPole-v1')])

model = A2C(MlpPolicy, env, verbose=1)

model.learn(total_timesteps=10000)在电力系统恢复场景下,我们可以用它来训练代理如何做出恢复动作。

- 其他辅助库:Matplotlib用于数据可视化,比如绘制电力系统恢复过程中的功率变化曲线;Pandas用于数据处理,像处理天气数据、电力系统运行数据等;Numpy进行数值计算;Networkx处理电力系统网络拓扑;PIL和Seaborn在一些可视化和数据展示方面也能发挥作用。

代码实现思路

- 环境构建:继承

gym.Env类,定义电力系统的状态,如各节点的电压、负载状态、可再生能源发电机状态等作为观测空间;定义恢复动作,如闭合开关、启动发电机等作为动作空间。在step函数中实现状态转移逻辑,根据代理的动作更新电力系统状态,并计算奖励。例如,如果成功恢复一个关键负载,可以给予一个正奖励;如果导致系统不稳定,则给予负奖励。

import gym

import numpy as np

class PowerSystemEnv(gym.Env):

def __init__(self):

# 定义状态空间和动作空间

self.observation_space = gym.spaces.Box(low=0, high=1, shape=(num_states,))

self.action_space = gym.spaces.Discrete(num_actions)

def step(self, action):

# 根据动作更新状态

new_state = self.state.copy()

# 假设这里有根据动作更新状态的逻辑

new_state[action] = 1 - new_state[action]

# 计算奖励

reward = self.calculate_reward(new_state)

self.state = new_state

done = all(self.state) # 所有负载恢复则结束

return np.array(self.state), reward, done, {}

def reset(self):

# 初始化电力系统状态为耗尽状态

self.state = np.zeros(num_states)

return np.array(self.state)

def calculate_reward(self, state):

# 简单奖励计算,恢复的负载越多奖励越高

return np.sum(state)- DRL算法训练:使用Stable - baselines中的算法,如PPO(近端策略优化算法),对代理进行训练。

from stable_baselines import PPO2

from stable_baselines.common.policies import MlpPolicy

from stable_baselines.common.vec_env import DummyVecEnv

env = DummyVecEnv([lambda: PowerSystemEnv()])

model = PPO2(MlpPolicy, env, verbose=1)

model.learn(total_timesteps=100000)- 结果评估与可视化:训练完成后,在测试环境中运行代理,观察电力系统的恢复过程。使用Matplotlib绘制恢复过程中的关键指标,如负载恢复数量随时间的变化曲线。

import matplotlib.pyplot as plt

obs = env.reset()

states = []

rewards = []

for i in range(100):

action, _states = model.predict(obs)

obs, reward, done, info = env.step(action)

states.append(obs)

rewards.append(reward)

if done:

break

plt.plot(range(len(rewards)), rewards)

plt.xlabel('Time Step')

plt.ylabel('Reward')

plt.title('Power System Restoration Reward')

plt.show()通过以上步骤,我们可以利用DRL技术在可再生能源比例较高的电力系统恢复领域取得一定进展,在实际应用中不断优化算法和模型,以更好地应对电力系统恢复的复杂挑战。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)