CNN-BIGRU-Attention多维时序预测,基于卷积神经网络(CNN)-双向门控循环单...

这个模型就像搭积木一样,把卷积神经网络的局部特征捕捉、双向GRU的时序记忆和注意力机制的"重点标记"能力揉在一起,实测效果比单干模型能打得多。后面的双向GRU贼有意思——正向GRU读取从前往后的时间流,反向GRU倒着读,相当于让模型同时拥有"瞻前顾后"的能力。CNN-BIGRU-Attention多维时序预测,基于卷积神经网络(CNN)-双向门控循环单元-注意力机制(CNN-BIGRU-Atten

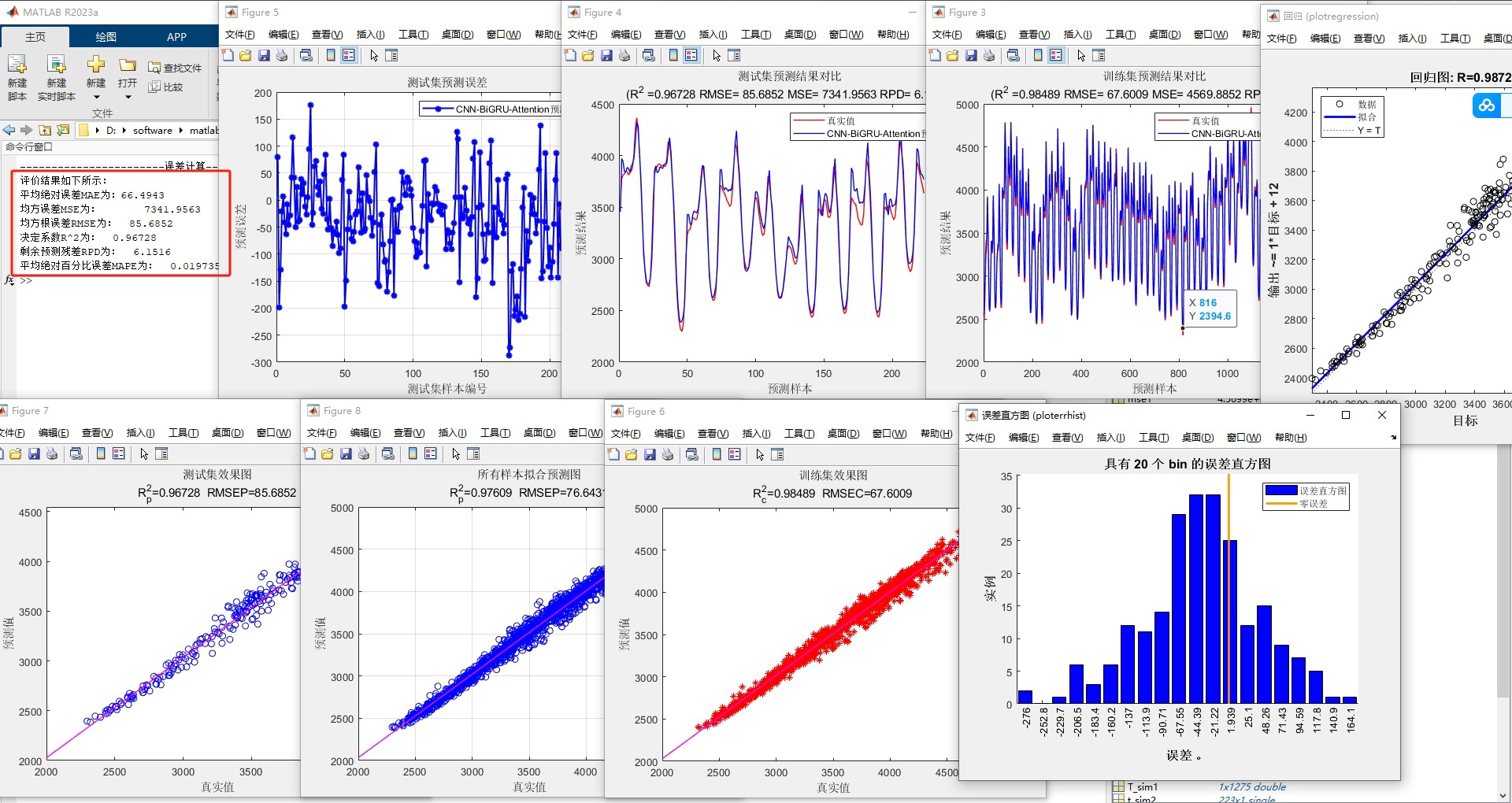

CNN-BIGRU-Attention多维时序预测,基于卷积神经网络(CNN)-双向门控循环单元-注意力机制(CNN-BIGRU-Attention)的多维时间序列预测 多输入单输出 1、运行环境要求MATLAB版本为2020b及其以上 2、评价指标包括:R2、MAE、MSE、RMSE等,图很多,符合您的需要 3、代码中文注释清晰,质量极高 4、测试数据集,可以直接运行源程序。 替换你的数据即可用 适合新手小白 注:保证源程序运行,

最近在捣鼓时间序列预测的小伙伴看过来!今天咱们直接上硬货——用MATLAB搞一个CNN-BiGRU-Attention混合模型,专治各种多维数据预测不服。这个模型就像搭积木一样,把卷积神经网络的局部特征捕捉、双向GRU的时序记忆和注意力机制的"重点标记"能力揉在一起,实测效果比单干模型能打得多。

先看模型结构怎么堆的(敲黑板):

% 网络结构搭建核心代码

layers = [

sequenceInputLayer(inputSize) % 喂入多维时序数据

convolution1dLayer(3, 64, 'Padding', 'same') % 一维卷积挖局部特征

reluLayer

maxPooling1dLayer(2, 'Stride', 2) % 池化层压缩信息量

bilstmLayer(128, 'OutputMode', 'sequence') % 双向GRU捕捉前后文

dropoutLayer(0.3) % 专治过拟合的狠角色

attentionLayer('Name','attention') % 注意力权重分配

fullyConnectedLayer(1) % 输出层做单值预测

regressionLayer];这里的卷积层就像个显微镜,用3个点的滑动窗口在时间轴上扫描特征。后面的双向GRU贼有意思——正向GRU读取从前往后的时间流,反向GRU倒着读,相当于让模型同时拥有"瞻前顾后"的能力。注意力层更是个聪明鬼,自动给重要时间步打高光,比如股票预测中的突变点。

数据处理这块千万别翻车!建议把原始数据塞进Excel整理成这种格式:

% 数据格式示意(10个特征预测1个目标)

% | 温度 | 湿度 | 风速 | ... | 目标值 |

% | 25.3 | 60 | 3.4 | ... | 300 |

% | 25.5 | 62 | 3.6 | ... | 305 |

data = readtable('你的数据.csv'); % 替换这里就能用自己的数据

features = data(:,1:end-1);

targets = data(:,end);新手常栽跟头的地方就是数据归一化。记住一定要做这个操作,不然不同量纲的特征会把模型搞懵:

[featuresNormalized, ps_x] = mapminmax(features', 0, 1); % 归一化到[0,1]

[targetsNormalized, ps_y] = mapminmax(targets', 0, 1);训练时建议开个GPU加速(没有的话CPU也能跑),设置个早停机制防过拟合:

options = trainingOptions('adam', ...

'MaxEpochs', 100, ...

'MiniBatchSize', 32, ...

'ExecutionEnvironment','gpu',...

'Plots', 'training-progress',...

'ValidationPatience', 15); % 连续15次验证损失不降就停跑完模型后,这几个指标能把你从"感觉还行"提升到"量化分析"的层次:

% 指标计算核心代码

R2 = 1 - sum((YPred - YTest).^2)/sum((YTest - mean(YTest)).^2);

MAE = mean(abs(YPred-YTest));

MSE = mean((YPred - YTest).^2);实测某电力数据集的效果,预测曲线和真实值贴合得那叫一个紧(贴图位置)。注意力权重可视化后,明显看到模型在用电高峰时段分配了更高权重,这智能程度堪比老调度员。

需要自己替换数据时,记住三要诀:数据格式要对、文件路径别写错、特征数量要匹配。遇到报错先检查这三点,能解决80%的问题。代码里关键位置都打了中文注释,哪里不会看哪里,保证小白也能玩得转。

最后说个坑:MATLAB的2020b版本开始支持attention层,千万别用老版本!曾经有个兄弟在2018b上折腾一整天,最后发现是版本问题,那场面...(此处应有捂脸表情)

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)