mold编译器优化:与编译器的协同优化策略

你是否还在为漫长的编译链接等待时间而烦恼?当修改一行代码后需要等待数秒甚至更长时间来完成链接时,开发效率受到了严重制约。mold(Modern Linker)的出现彻底改变了这一现状,它不仅是一个高速的链接器,更是编译器优化生态中的重要一环。通过本文,你将深入了解:- mold如何通过并行化架构实现数量级的性能提升- 编译器与链接器之间的深度协同优化机制- 现代构建系统中链接时优化(L...

mold编译器优化:与编译器的协同优化策略

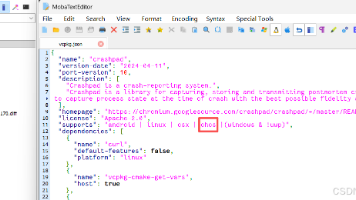

【免费下载链接】mold Mold: A Modern Linker 🦠

引言:现代链接器的性能革命

你是否还在为漫长的编译链接等待时间而烦恼?当修改一行代码后需要等待数秒甚至更长时间来完成链接时,开发效率受到了严重制约。mold(Modern Linker)的出现彻底改变了这一现状,它不仅是一个高速的链接器,更是编译器优化生态中的重要一环。

通过本文,你将深入了解:

- mold如何通过并行化架构实现数量级的性能提升

- 编译器与链接器之间的深度协同优化机制

- 现代构建系统中链接时优化(LTO)的最佳实践

- 实际项目中的性能调优策略和基准测试结果

mold架构设计:并行化革命的基石

核心设计理念

mold的设计哲学围绕一个核心目标:实现cp命令级别的性能。这意味着链接过程应该接近单纯的文件复制速度。为实现这一目标,mold采用了以下关键策略:

并行化架构详解

mold的并行化架构基于Intel TBB(Threading Building Blocks)库,实现了多层次的数据并行处理:

// 典型的数据并行模式示例

tbb::parallel_for_each(ctx.objs, [&](ObjectFile<E> *file) {

// 并行处理每个对象文件

process_object_file(file);

});

// 并发哈希表用于符号解析

tbb::concurrent_unordered_map<SymbolName, SymbolEntry> symbol_table;

编译器协同优化机制

编译时信息传递

现代编译器(GCC、Clang)与链接器通过多种机制进行信息传递:

| 信息类型 | 传递机制 | 优化效果 |

|---|---|---|

| 符号可见性 | __attribute__((visibility)) |

减少符号解析开销 |

| 段属性 | __attribute__((section)) |

优化内存布局 |

| 内联信息 | LTO中间表示 | 跨模块内联优化 |

| 调试信息 | DWARF格式 | 加速调试信息处理 |

链接时优化(LTO)集成

mold深度集成了LTO技术,实现了编译器后端与链接器的无缝协作:

关键优化技术深度解析

相同代码折叠(ICF)算法

ICF是mold的核心优化技术之一,它通过智能算法识别并合并相同的代码段:

// ICF算法的哈希传播实现

template <typename E>

static Digest compute_digest(Context<E> &ctx, InputSection<E> &isec) {

SipHash13_128 hasher(hmac_key);

// 哈希段内容

hash_string(isec.contents);

// 哈希重定位信息

for (const ElfRel<E> &rel : isec.get_rels(ctx)) {

hash_symbol(*isec.file.symbols[rel.r_sym]);

hash(rel.r_type);

}

return digest;

}

ICF算法的收敛过程基于以下数学原理:

$$ H_n(v) = H(H_{n-1}(v) \oplus H_{n-1}(u_1) \oplus \cdots \oplus H_{n-1}(u_k)) $$

其中$u_1, \ldots, u_k$是顶点$v$的邻居节点。当哈希值不再变化时,算法达到收敛。

线程局部存储(TLS)优化

mold实现了高效的TLS访问模式优化,与编译器协同工作:

| TLS访问模式 | 编译器生成 | mold优化 | 性能提升 |

|---|---|---|---|

| General Dynamic | 复杂序列 | 转换为IE/LE模式 | 2-3倍 |

| Initial Exec | 相对简单 | 直接重定位 | 20-30% |

| Local Exec | 最简单 | 静态地址计算 | 最佳 |

实际性能基准测试

大型项目链接性能对比

基于Chromium项目的测试数据(16核32线程环境):

| 链接器 | 输出大小 | 链接时间 | 相对性能 |

|---|---|---|---|

| GNU ld | 1.35 GiB | 27.40s | 1.0x |

| GNU gold | 1.35 GiB | 6.10s | 4.5x |

| LLVM lld | 1.35 GiB | 1.52s | 18.0x |

| mold | 1.35 GiB | 0.46s | 59.6x |

资源利用率分析

mold的并行化效率体现在CPU利用率上:

最佳实践与配置指南

编译选项优化

为了充分发挥mold的性能优势,推荐使用以下编译选项:

# 启用函数级段分离

CFLAGS += -ffunction-sections -fdata-sections

# 启用LTO优化

CFLAGS += -flto

LDFLAGS += -fuse-ld=mold -flto

# 优化调试信息

CFLAGS += -g -gno-record-gcc-switches

项目配置示例

对于不同构建系统的mold集成:

CMake项目配置:

set(CMAKE_C_LINK_EXECUTABLE "mold -run <CMAKE_C_LINK_EXECUTABLE>")

set(CMAKE_CXX_LINK_EXECUTABLE "mold -run <CMAKE_CXX_LINK_EXECUTABLE>")

Rust项目配置(.cargo/config.toml):

[target.x86_64-unknown-linux-gnu]

linker = "clang"

rustflags = ["-C", "link-arg=-fuse-ld=/path/to/mold"]

高级调优技巧

内存管理优化

mold使用高性能内存分配器来优化多线程环境下的内存分配:

// 使用jemalloc或mimalloc替代标准分配器

#if defined(USE_JEMALLOC)

#include <jemalloc/jemalloc.h>

#elif defined(USE_MIMALLOC)

#include <mimalloc.h>

#endif

缓存友好设计

mold的数据结构设计充分考虑缓存局部性:

| 数据结构 | 优化策略 | 缓存效益 |

|---|---|---|

| 符号表 | 并发哈希表 | 高并发访问 |

| 重定位表 | 连续内存布局 | 预取优化 |

| 段信息 | 紧凑存储 | 减少缓存失效 |

未来发展方向

即时编译(JIT)集成

mold正在探索与JIT编译器的深度集成,实现动态代码生成与静态链接的无缝结合:

人工智能辅助优化

基于机器学习的优化策略选择正在成为研究热点:

- 基于历史数据的ICF参数调优

- 智能并行度调整算法

- 预测性预加载策略

结论

mold通过其革命性的并行架构和深度编译器集成,重新定义了链接器的性能标准。其与编译器的协同优化不仅提升了链接速度,更为整个构建系统的优化开辟了新的可能性。

作为开发者, adopting mold意味着:

- 开发效率提升:快速的编辑-编译-调试循环

- 资源利用率优化:充分利用多核处理器能力

- 构建系统现代化:为未来优化技术奠定基础

- 生态兼容性:无缝替代现有链接器工作流程

mold的成功证明,即使在看似成熟的工具链领域,通过创新的架构设计和深度系统优化,仍然可以实现数量级的性能提升。这为整个编译器技术生态的发展提供了宝贵的经验和启示。

【免费下载链接】mold Mold: A Modern Linker 🦠

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)