书生大模型4期进阶岛闯关3--LMDeploy 量化部署实践

W4:这通常表示权重量化为4位整数(int4)。这意味着模型中的权重参数将从它们原始的浮点表示(例如FP32、BF16或FP16,Internlm2.5精度为BF16)转换为4位的整数表示。这样做可以显著减少模型的大小。A16:这表示激活(或输入/输出)仍然保持在16位浮点数(例如FP16或BF16)。激活是在神经网络中传播的数据,通常在每层运算之后产生。那么标题中的W4A16又是什么意思呢?激活

·

任务

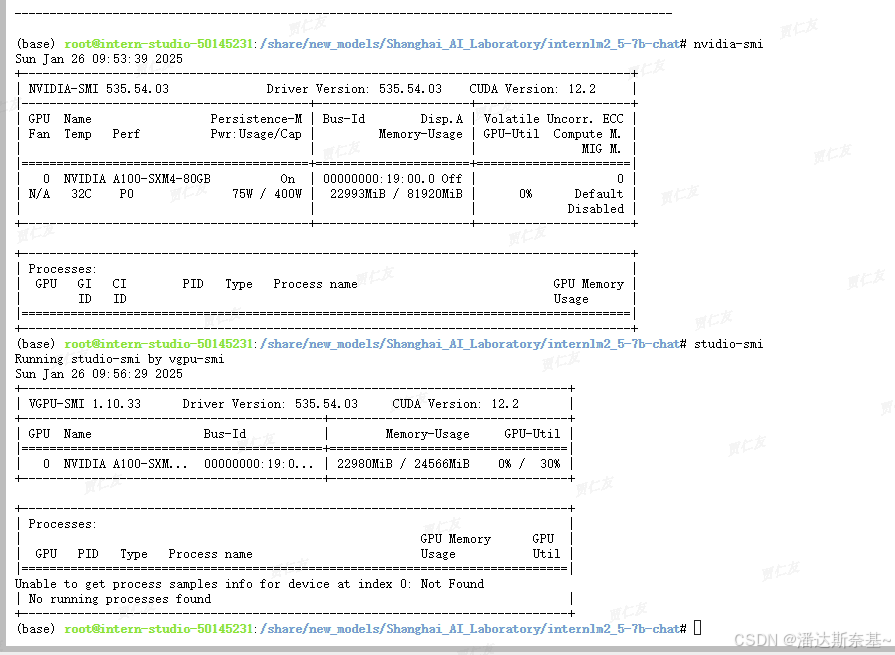

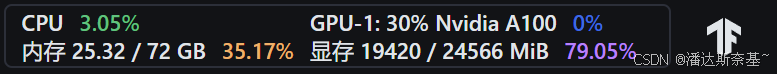

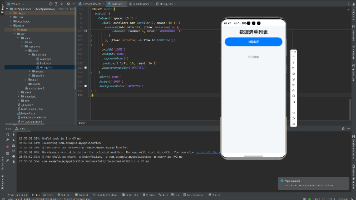

- 使用结合W4A16量化与kv cache量化的internlm2_5-1_8b-chat模型封装本地API并与大模型进行一次对话,作业截图需包括显存占用情况与大模型回复,参考4.1 API开发,请注意2.2.3节与4.1节应使用作业版本命令。

- 使用Function call功能让大模型完成一次简单的"加"与"乘"函数调用,作业截图需包括大模型回复的工具调用情况,参考4.2 Function call(选做)

学习链接

https://github.com/InternLM/Tutorial/tree/camp4/docs/L2/LMDeploy

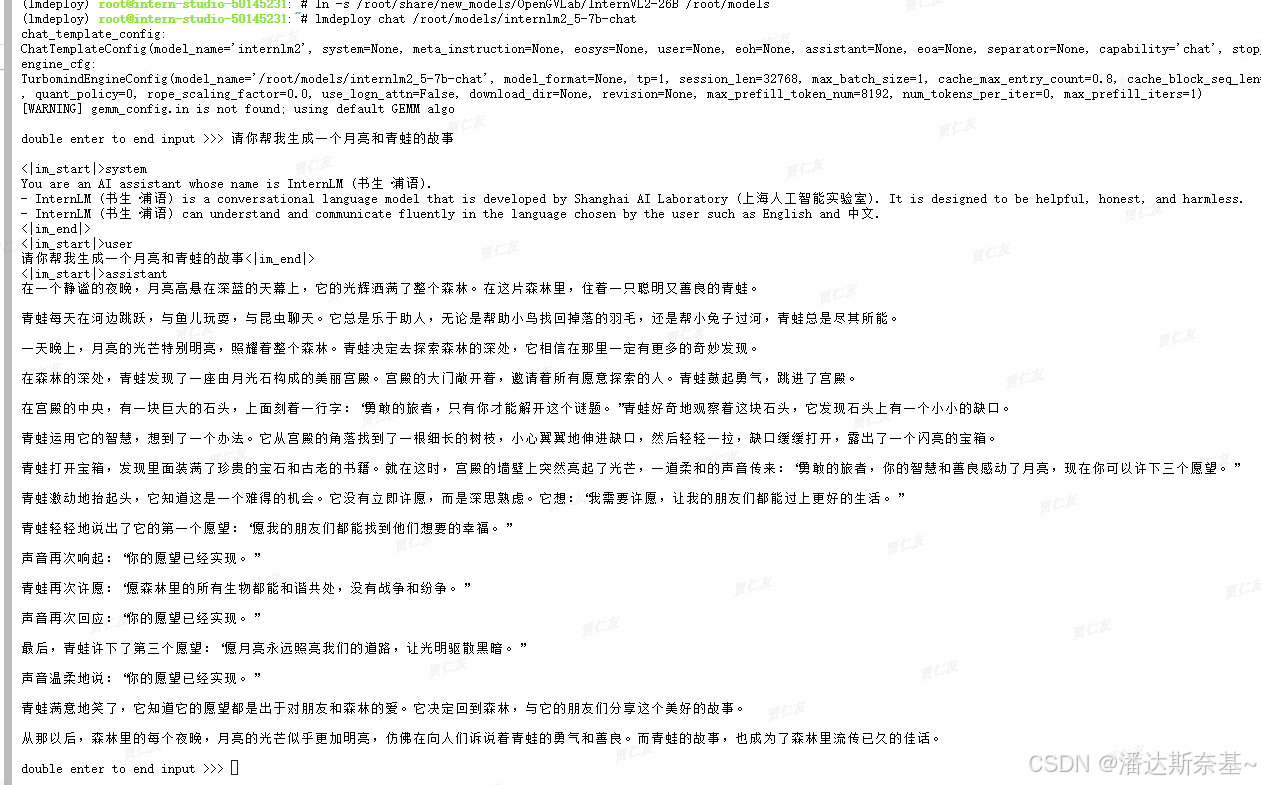

任务一

2.2 LMDeploy Lite

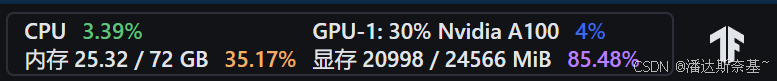

2.2.1 设置最大kv cache缓存大小

lmdeploy chat /root/models/internlm2_5-7b-chat --cache-max-entry-count 0.4

2.2.2 设置在线 kv cache int4/int8 量化

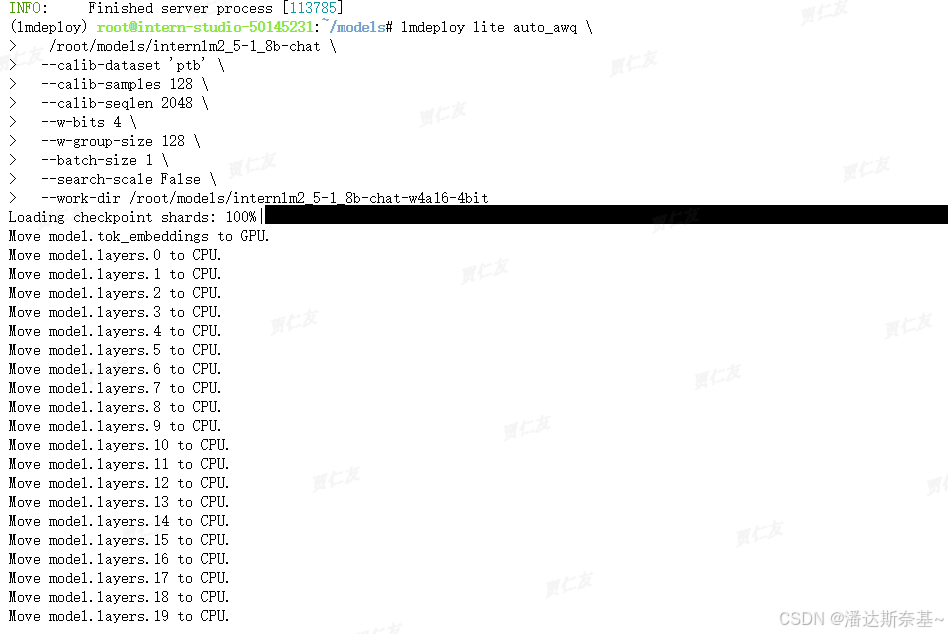

2.2.3 W4A16 模型量化和部署

那么标题中的W4A16又是什么意思呢?

-

W4:这通常表示权重量化为4位整数(int4)。这意味着模型中的权重参数将从它们原始的浮点表示(例如FP32、BF16或FP16,Internlm2.5精度为BF16)转换为4位的整数表示。这样做可以显著减少模型的大小。

-

A16:这表示激活(或输入/输出)仍然保持在16位浮点数(例如FP16或BF16)。激活是在神经网络中传播的数据,通常在每层运算之后产生。

因此,W4A16的量化配置意味着: -

权重被量化为4位整数。

-

激活保持为16位浮点数。

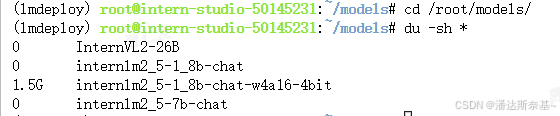

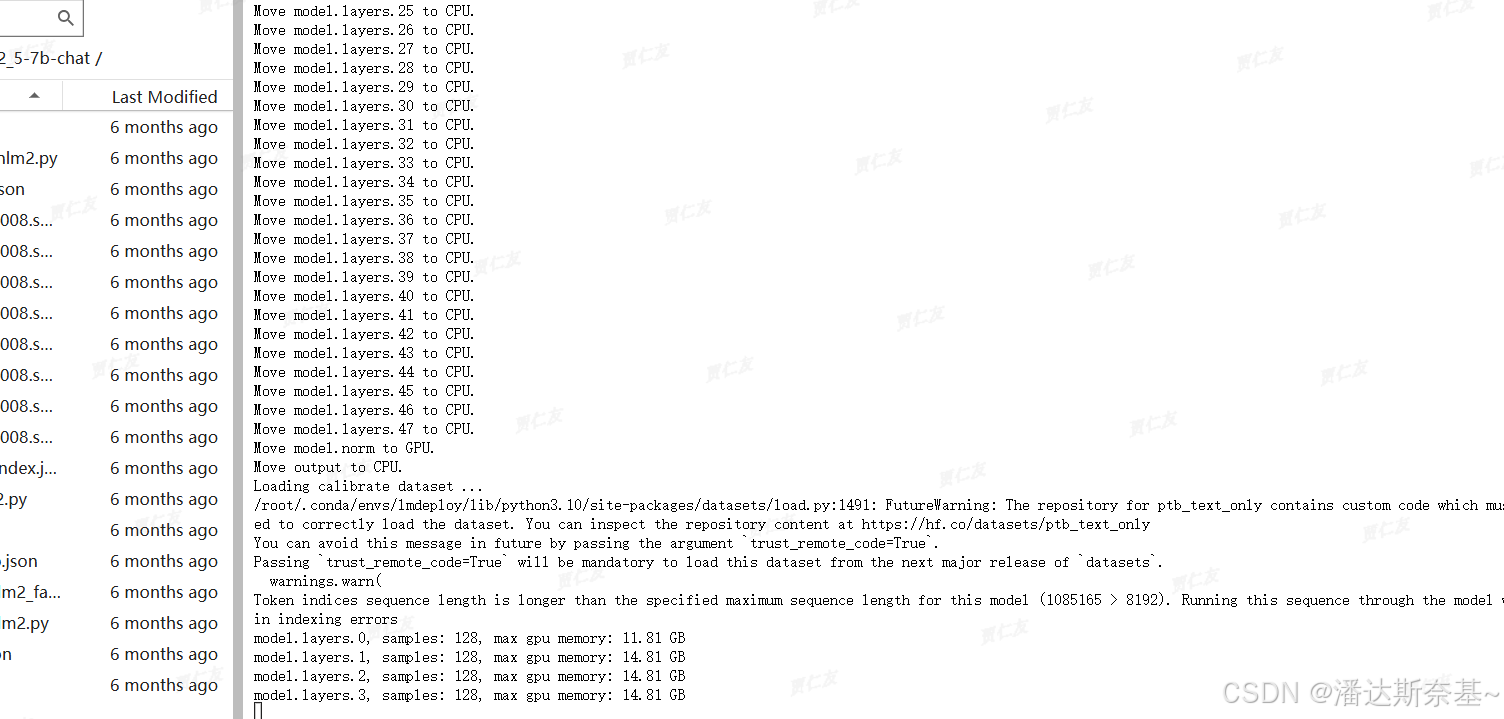

执行以下代码

lmdeploy lite auto_awq \

/root/models/internlm2_5-1_8b-chat \

--calib-dataset 'ptb' \

--calib-samples 128 \

--calib-seqlen 2048 \

--w-bits 4 \

--w-group-size 128 \

--batch-size 1 \

--search-scale False \

--work-dir /root/models/internlm2_5-1_8b-chat-w4a16-4bit

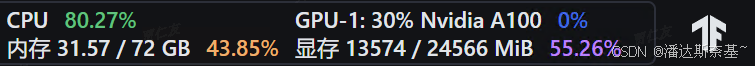

2.2.4 W4A16 量化+ KV cache+KV cache 量化

lmdeploy serve api_server \

/root/models/internlm2_5-7b-chat-w4a16-4bit/ \

--model-format awq \

--quant-policy 4 \

--cache-max-entry-count 0.4\

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)