当测试遇见AI偏见:软件质量保障的新战场

AI模型偏差检测的挑战与方法 随着AI在金融、医疗等关键领域的应用,78%的投产模型存在隐性偏见(斯坦福2025)。本文探讨AI偏差检测的前沿方法: 测试维度:欧盟AI法案要求高风险系统提供偏差检测报告; 工具实践:Aequitas、Fairlearn等开源框架及IBM Watson等商业平台助力可视化与优化; 行业痛点:历史数据失衡导致算法放大偏见(如招聘平台性别偏差案例); 能力升级:需统计学

·

随着金融风控、医疗诊断等关键领域广泛采用AI决策,2025年斯坦福研究显示:78%的投产模型存在隐性偏见。这使传统测试工程师面临全新挑战——如何检测看不见的算法歧视?本文聚焦机器学习模型偏差检测的前沿方法与实践路径。

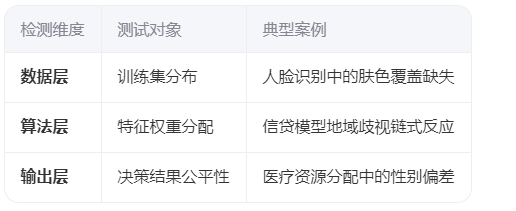

一、AI偏差的测试维度矩阵

注:欧盟AI法案(2025)要求高风险系统必须提供偏差检测报告

二、测试工程师的实战工具箱

-

开源检测框架

-

Aequitas(卡耐基梅隆大学):可视化偏见热力图

-

Fairlearn(微软):敏感属性约束优化

-

# Fairlearn约束优化示例

from fairlearn.reductions import ExponentiatedGradient

mitigator = ExponentiatedGradient(LogisticRegression(), constraints="demographic_parity")

-

商业测试平台

-

IBM Watson OpenScale:实时监测生产环境偏差漂移

-

Google What-If Tool:决策边界可视化渗透测试

-

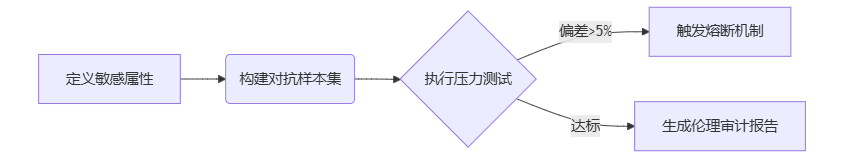

三、突破行业痛点的方法论

测试用例设计黄金法则

2025年典型事故复盘

某招聘平台AI筛选器被曝男性简历通过率高出女性37%,根本原因为:

历史数据包含行业性别比例失衡

算法放大了“管理岗位”与男性关联词权重

四、未来三年测试能力升级路线

-

技能转型

-

统计学敏感度提升(基尼系数/卡方检验)

-

伦理委员会协同工作机制

-

-

流程再造

+ 新增偏见测试准入标准

+ 建立跨学科评审小组

- 取消纯准确率考核指标

精选文章:

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)