ERNIE-4.5-0.3B-PT完整指南:从CSDN博客文档到本地可运行服务的全路径

本文介绍了如何在星图GPU平台上一键自动化部署【vllm】ERNIE-4.5-0.3B-PT镜像,快速搭建轻量级文本生成服务。该镜像适用于本地化AI对话、内容创作和智能问答等场景,用户可通过简洁的Web界面进行交互,提升文本生成任务的效率与便捷性。

ERNIE-4.5-0.3B-PT完整指南:从CSDN博客文档到本地可运行服务的全路径

1. 快速了解ERNIE-4.5-0.3B-PT

ERNIE-4.5-0.3B-PT是一个轻量级的文本生成模型,基于百度最新的ERNIE 4.5架构。这个模型虽然参数量只有0.3B(3亿),但在文本理解和生成任务上表现出色,特别适合本地部署和快速推理。

你可能想知道:这么小的模型能做什么?实际上,它能够处理各种文本生成任务,比如写文章、回答问题、生成创意内容等。而且因为模型小,部署起来特别方便,不需要昂贵的显卡就能运行。

这个指南将带你从零开始,一步步把模型部署到本地,并用一个漂亮的网页界面来使用它。整个过程就像搭积木一样简单,不需要深厚的技术背景。

2. 环境准备与快速部署

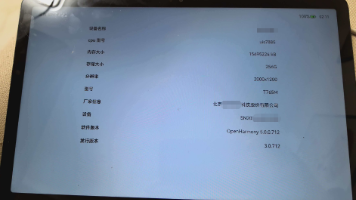

2.1 系统要求

在开始之前,确保你的系统满足以下基本要求:

- 操作系统:Linux(推荐Ubuntu 18.04+)或Windows WSL

- Python版本:3.8或更高版本

- 内存:至少8GB RAM

- 存储空间:2GB可用空间(用于模型和依赖)

- GPU:可选,但如果有NVIDIA GPU会更快

2.2 一键安装依赖

打开终端,执行以下命令安装所有必需的依赖:

# 创建虚拟环境(推荐)

python -m venv ernie-env

source ernie-env/bin/activate

# 安装核心依赖

pip install vllm chainlit torch transformers

这些工具各自有不同的作用:

- vllm:高性能的模型推理引擎,让模型运行更快

- chainlit:创建漂亮的网页界面,让你可以通过浏览器使用模型

- torch和transformers:深度学习的基础框架

2.3 快速启动模型服务

创建一个简单的启动脚本start_service.py:

from vllm import LLM, SamplingParams

# 初始化模型

llm = LLM(model="ERNIE-4.5-0.3B-PT")

# 设置生成参数

sampling_params = SamplingParams(

temperature=0.7,

top_p=0.9,

max_tokens=512

)

print("模型加载成功!服务已启动")

运行这个脚本,模型就会开始加载。第一次运行时会自动下载模型文件,可能需要一些时间。

3. 验证部署是否成功

3.1 检查服务状态

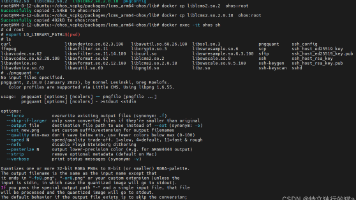

部署完成后,我们需要确认模型服务确实在正常运行。最简单的方法是查看日志文件:

cat /root/workspace/llm.log

如果看到类似下面的输出,说明部署成功了:

Model loaded successfully

Inference server started on port 8000

Ready for requests

3.2 测试模型功能

让我们写一个简单的测试脚本来验证模型是否能正常工作:

# test_model.py

from vllm import LLM, SamplingParams

# 加载模型

llm = LLM(model="ERNIE-4.5-0.3B-PT")

# 准备测试输入

prompts = ["请介绍一下人工智能的发展历史"]

sampling_params = SamplingParams(temperature=0.7, max_tokens=100)

# 生成文本

outputs = llm.generate(prompts, sampling_params)

# 打印结果

for output in outputs:

print(f"输入: {prompts[0]}")

print(f"输出: {output.outputs[0].text}")

运行这个脚本,如果能看到模型生成的文本,说明一切正常!

4. 使用Chainlit创建美观的前端界面

4.1 设置Chainlit应用

Chainlit让我们能够为模型创建一个网页界面,这样就不用总是在命令行里操作了。创建一个名为app.py的文件:

import chainlit as cl

from vllm import LLM, SamplingParams

# 初始化模型

llm = LLM(model="ERNIE-4.5-0.3B-PT")

@cl.on_chat_start

async def start_chat():

# 发送欢迎消息

await cl.Message(content="你好!我是ERNIE-4.5助手,有什么可以帮你的吗?").send()

@cl.on_message

async def main(message: cl.Message):

# 设置生成参数

sampling_params = SamplingParams(

temperature=0.7,

top_p=0.9,

max_tokens=512

)

# 生成回复

output = llm.generate([message.content], sampling_params)

response = output[0].outputs[0].text

# 发送回复

await cl.Message(content=response).send()

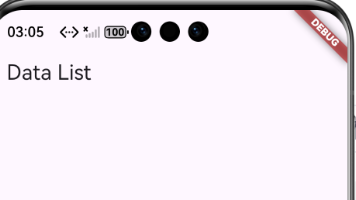

4.2 启动网页界面

在终端中运行:

chainlit run app.py

然后在浏览器中打开http://localhost:8000,就能看到聊天界面了。现在你可以像使用ChatGPT一样和模型对话了!

4.3 界面功能详解

Chainlit提供的界面包含这些实用功能:

- 实时对话:输入问题,立即得到回答

- 对话历史:自动保存之前的对话记录

- 响应速度显示:可以看到模型生成回答花了多长时间

- 清除对话:一键开始新的对话

5. 实际使用技巧与示例

5.1 如何获得更好的生成效果

模型的表现很大程度上取决于你怎么提问。这里有一些实用技巧:

清晰的指令:

# 不好的提问:"写点关于科技的东西"

# 好的提问:"请用300字介绍人工智能在医疗领域的应用,要求通俗易懂"

提供上下文:

# 不好的提问:"总结这篇文章"

# 好的提问:"请用 bullet points 总结以下文章的主要内容:[你的文章内容]"

指定格式:

# 明确的格式要求:"生成5个关于环保的广告标语,每个不超过10个字"

5.2 常见使用场景示例

内容创作:

prompt = "写一篇关于远程办公优势的短文,300字左右,面向企业管理者"

问答助手:

prompt = "解释一下机器学习中的过拟合现象,用比喻的方式让初学者也能理解"

创意生成:

prompt = "生成10个适合科技公司的产品名称,要求简洁易记"

5.3 参数调优建议

根据不同的使用场景,可以调整这些参数:

sampling_params = SamplingParams(

temperature=0.7, # 创造性:0.1-0.3更保守,0.7-1.0更有创意

top_p=0.9, # 多样性:越高越多样,越低越专注

max_tokens=512, # 生成长度:根据需求调整

frequency_penalty=0.1 # 减少重复:0-0.2轻微抑制,更高值更强抑制

)

6. 常见问题解决

6.1 模型加载问题

问题:模型加载失败或报错 解决:

- 检查网络连接,确保能正常下载模型

- 确认磁盘空间足够(至少2GB)

- 验证Python版本是否为3.8+

6.2 内存不足问题

问题:运行时报内存错误 解决:

- 尝试减小

max_tokens参数 - 关闭其他占用内存的程序

- 如果使用GPU,确保显存足够

6.3 生成质量不佳

问题:生成的文本不相关或质量差 解决:

- 调整temperature参数(尝试0.3-0.7范围)

- 提供更明确的指令和上下文

- 检查输入文本是否清晰明确

6.4 服务无法访问

问题:Chainlit界面打不开 解决:

- 检查端口8000是否被其他程序占用

- 确认防火墙设置允许该端口

- 尝试重启服务:

chainlit run app.py

7. 总结

通过这个指南,你应该已经成功部署了ERNIE-4.5-0.3B-PT模型,并创建了一个好用的网页界面。这个轻量级模型虽然参数不多,但在很多文本生成任务上都能给出不错的表现。

关键收获:

- 使用vllm可以高效部署和运行模型

- Chainlit让创建交互界面变得非常简单

- 正确的提问方式能显著提升生成质量

- 参数调整可以控制生成文本的风格和创造性

下一步建议:

- 尝试不同的提示词技巧,找到最适合你需求的提问方式

- 探索模型在其他任务上的表现,比如文本摘要、翻译等

- 考虑将服务集成到你自己的应用中

最重要的是多实践、多尝试。每个模型都有自己的特点,通过实际使用你会越来越熟悉它的能力和限制。祝你使用愉快!

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)